共计 3145 个字符,预计需要花费 8 分钟才能阅读完成。

AIxiv专栏是机器之心发布学术、技术内容的栏目。过去数年,机器之心AIxiv专栏接收报道了2000多篇内容,覆盖全球各大高校与企业的顶级实验室,有效促进了学术交流与传播。如果您有优秀的工作想要分享,欢迎投稿或者联系报道。投稿邮箱:liyazhou@jiqizhixin.com;zhaoyunfeng@jiqizhixin.com

3D 重建和新视图合成技术在虚拟现实和增强现实等领域有着广泛的应用。NeRF 通过隐式地将场景编码为辐射场,在视图合成上取得了显著的成功。然而,由于 NeRF 依赖于耗时的逐场景优化,极大地限制了其实用性。为了解决这一问题,出现了一些可泛化的 NeRF 方法,旨在通过网络前馈的方式从多视图中重建场景。然而,由于基于 NeRF 的方法需要在射线上查询密集的点进行渲染,因此速度受到了限制。最近,3D Gaussian Splatting(3D-GS)采用了各向异性 3D 高斯来显式表示场景,并通过可微分的光栅化器实现了实时高质量的渲染。

然而,3D-GS 同样依赖于每个场景的优化,每个场景需要几十分钟的时间。为了解决这个问题,后续出现了一些泛化性的高斯重建工作,尝试将 3D-GS 推广到未见过的场景,然而,这些方法的训练和渲染效率还有待提升且主要局限于物体或人体的重建。

基于此,来自华中科技大学、南洋理工大学、大湾区大学和上海人工智能实验室的研究者联合提出了一种高效的、可泛化的高斯重建模型,称为 MVSGaussian,用于未见过的一般场景的新视图合成。

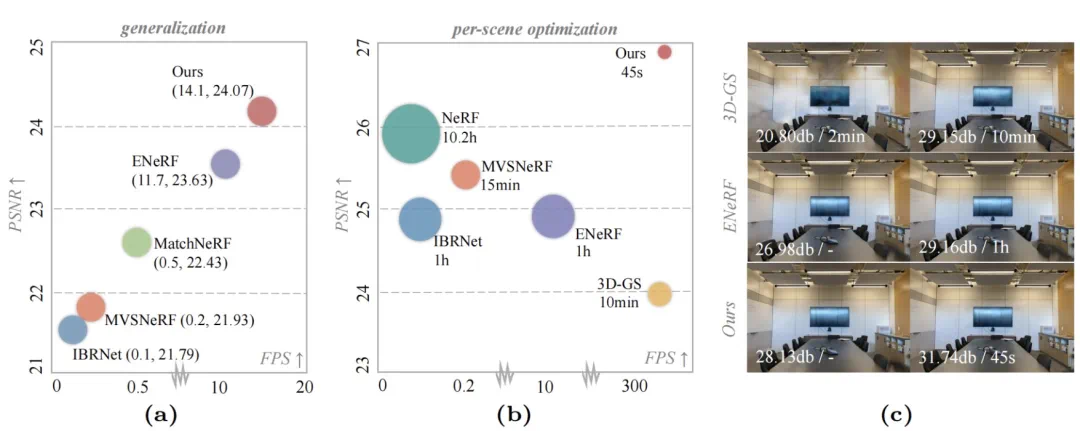

该模型能够从稀疏多视角图像中学习场景的 3D 高斯表征。通过结合多视角立体(MVS)的显式几何推理和高斯溅射实时渲染的优势,MVSGaussian 在泛化推理上表现出色,能够以最快的速度实现最佳的视图渲染质量。此外,MVSGaussian 在逐场景优化方面也有显著优势,仅需 45 秒(约为 3D-GS 的 1/10)即可完成高质量的实时渲染。

图 1 无论是泛化推理还是逐场景优化,MVSGaussian 在视图质量、渲染速度和优化时间都表现出了明显的优势。

图 2 渲染视图质量随优化时间(迭代次数)的变化对比。由于可泛化模型提供了良好的初始化,MVSGaussian 后续只需要较短的优化时间 (较少的迭代次数) 便可以实现高质量的视图合成。

基本原理

设计一种高效的、可泛化的高斯溅射框架,我们面临以下几个关键挑战:

1)与使用隐式表示的 NeRF 不同,3D-GS 显式地使用数百万个 3D 高斯球来表达场景。将预训练的 3D-GS 应用于未见过的场景时,3D 高斯球的参数(如位置和颜色)会显著不同。设计一种通用的表征来适配 3D-GS 是一项非平凡的任务。

2)可泛化 NeRF 方法通过体渲染实现了令人印象深刻的视图合成效果。然而,高斯溅射的泛化能力尚未被充分探索。在溅射过程中,每个高斯球会对图像的某一区域内的多个像素做出贡献,同时每个像素的颜色由多个高斯球的贡献累积得到。高斯球和像素之间的颜色对应是一个更加复杂的多对多关系,这对模型的泛化能力构成了挑战。

3)可泛化的 NeRF 方法表明,对特定场景进行进一步微调可以显著改善合成视图的质量,但这需要耗费大量时间进行优化。尽管 3D-GS 比 NeRF 更快,但仍然需要较长的时间。因此,设计一种基于可泛化模型进行快速逐场景优化的方法是一个非常有前景的研究方向。

针对上述挑战,我们给出了我们的解决方案。

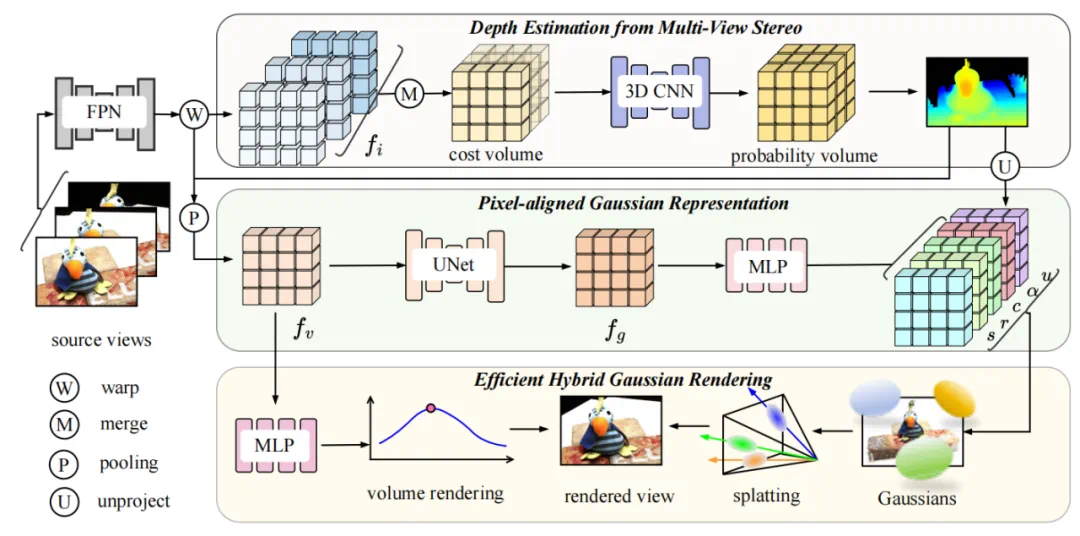

1)由于每个场景对应的高斯球的位置分布是不同的,因此我们利用多视角立体(MVS)显式建模场景的几何,推理得到深度。接着,我们对估计的深度所对应的 3D 点编码特征,以建立像素对齐的高斯表征。

2)基于编码的特征,我们可以通过 MLP 将其解码为高斯参数,从而利用溅射技术渲染视图。然而,我们发现这种方式的泛化能力有限。我们的见解是,溅射方式在颜色贡献方面引入了复杂的多对多关系,即高斯球与像素之间的关系,这对泛化提出了挑战。因此,我们提出了一种简单而有效的深度感知的体渲染方法来增强泛化能力,即采用单一采样点的体渲染方式。最终的渲染视图是通过对溅射技术和体渲染技术渲染的视图进行平均得到的。

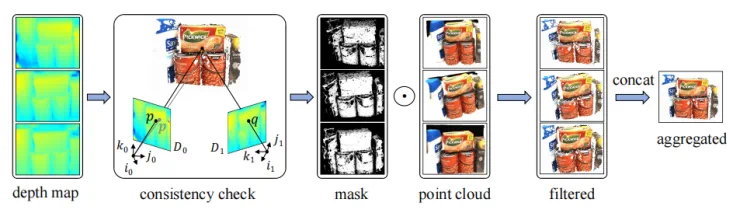

3)预训练的可泛化模型可以从多个视角生成大量 3D 高斯,这些高斯点云可以作为后续逐场景优化的初始化。然而,由于 MVS 方法的固有局限性,可泛化模型预测的深度可能并不完全准确,导致生成的高斯点云中存在噪声。直接将这些高斯点云拼接在一起会产生大量噪声。此外,大量的点会降低后续优化和渲染速度。一个直观的解决方案是对拼接的点云进行降采样。然而,虽然能减少噪声,但也会减少有效点的数量。我们的见解是,一个好的聚合策略应尽可能地减少噪声点并保留有效点,同时确保点的总数不过大。为此,我们引入了一种基于多视图几何一致性的聚合策略。具体而言,我们遵循同一 3D 点在不同视角下的预测深度应具有一致性的原则,通过计算来自不同视角的高斯深度的重投影误差来滤除噪声点。

图 3 可泛化高斯溅射框架。首先使用特征金字塔网络(FPN)从输入视图中提取特征,这些特征被扭曲到目标视角,构建代价体,再通过 3D CNNs 正则化生成深度。接着,对于深度对应的 3D 点,我们通过汇聚多视图和空间信息编码特征,建立像素对齐的高斯表征。这些特征随后被解码为高斯参数和体渲染参数,通过这两种方式渲染得到两个视图,最终的结果是这两个视图的平均值。

图 4 一致性聚合。使用可泛化模型生成深度图和高斯点云,我们首先对深度图进行多视图几何一致性检查,以得到用于过滤不可靠点的 mask。随后,将经过滤的点云拼接成一个点云,作为逐场景优化的初始化。

结果比较

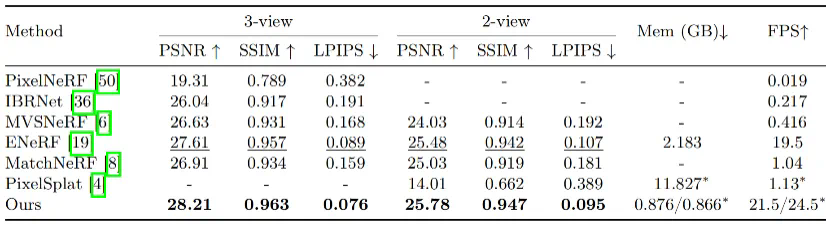

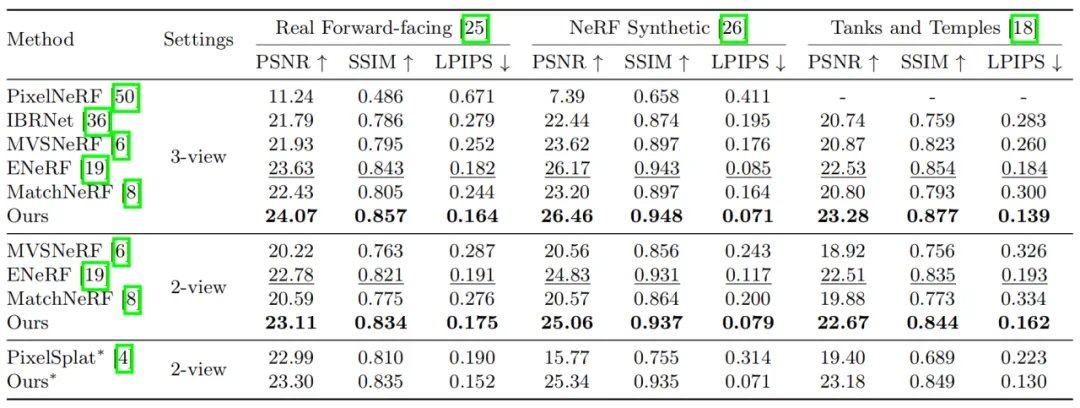

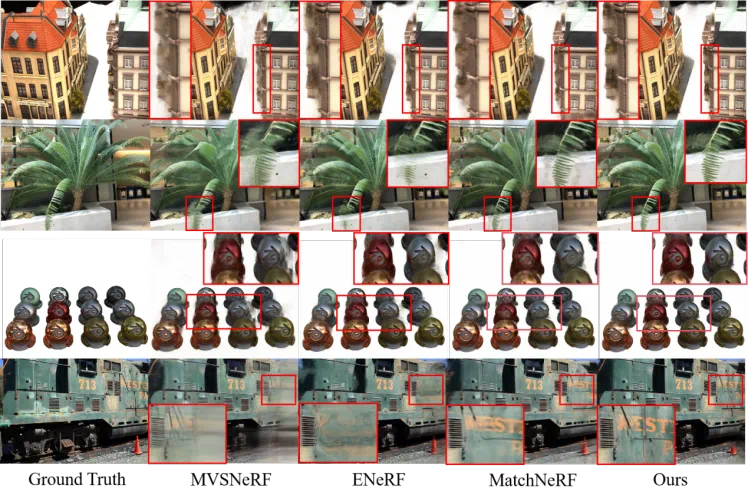

本文在广泛使用的 DTU、Real Forward-facing、NeRF Synthetic 和 Tanks and Temples 数据集上进行了评估,报告了 PSNR、SSIM、LPIPS 和 FPS 等指标。在泛化推理方面(表 1 和表 2),MVSGaussian 展现出了卓越的性能,以最快的速度和最小的内存开销实现了更好的性能。在逐场景优化方面(表 3),MVSGaussian 能够在最短的优化时间内(大约是 3D-GS 的 1/10)实现最佳的视图合成效果,并且保持了与 3D-GS 相当的实时渲染速度。定性的视图和视频对比中也展示了 MVSGaussian 能够合成高质量的视图,具有更多的场景细节和更少的伪影。更多视频结果请见项目主页。

表 1 DTU 测试集上的泛化定量结果。

表 2 Real Forward-facing、NeRF Synthetic 和 Tanks and Temples 数据集上的泛化定量结果。

表 3 逐场景优化后的定量结果。

图 5 泛化推理的结果对比。

图 6 泛化结果的视频对比

图 7 逐场景优化后的结果对比。

图 8 逐场景优化后的视频对比。

结语

在本文中,我们提出了 MVSGaussian,这是一种新颖的可泛化高斯溅射方法,用于从多视图中重建场景。具体来说,我们利用 MVS 推理几何,建立像素对齐的高斯表征。此外,我们提出了一种混合高斯渲染方法,该方法结合了高效的深度感知体渲染以增强泛化能力。除了直接泛化推理外,我们的模型还可以针对特定场景进行快速地微调。为了实现快速优化,我们引入了一种多视图几何一致性聚合策略,以提供高质量的初始化。与通常需要数十分钟微调和几秒钟渲染每张图像的可泛化 NeRF 相比,MVSGaussian 实现了实时渲染,并具有更高的合成质量。

此外,与 3D-GS 相比,MVSGaussian 在减少训练计算成本的同时,实现了更好的视图合成效果。大量实验验证了 MVSGaussian 在泛化性能、实时渲染速度和快速逐场景优化方面达到了最先进的水平。然而,由于 MVSGaussian 依赖于多视角立体(MVS)进行深度估计,因此它继承了 MVS 的局限性,例如在纹理较弱或有镜面反射的区域深度准确性降低,导致视图质量下降。